Coraz większa dostępność chatbotów AI sprawia, że wiele osób zaczyna traktować je jak narzędzie do stawiania samodiagnoz. Choć mogą być pomocne w szybkim dostępie do informacji, w obszarze zdrowia psychicznego ich używanie niesie poważne ryzyka. Ten artykuł przygląda się złudnemu poczuciu bezpieczeństwa, jakie daje rozmowa z inteligentnym modelem, zagrożeniom wynikającym z prób zastąpienia specjalisty sztuczną inteligencją oraz realnym konsekwencjom, jakie opisano w badaniach i medialnych przypadkach.

DOKTORchat – nowa pokusa samodiagnozowania

Natychmiastowy dostęp do informacji w dobie AI nabiera zupełnie nowego znaczenia – już nie “wujek Google”, a DOKTORchat, któremu wystarczy podyktować kilka informacji, by otrzymać rozbudowane i szczegółowe odpowiedzi. W kontekście pytań dnia codziennego, jak np. rozkłady jazdy, weryfikacje składów produktów czy godziny otwarcia sklepów, chat sprawdza się doskonale. Niepokoją jednak te dotyczące zdrowia psychicznego oraz fizycznego – to niebezpieczna pułapka, w którą wpada coraz więcej osób. Dostępność chata 24h na dobę, jego bezpłatność, anonimowość czy też łatwość użycia sprawia, że ludzie szukają pomocy psychologicznej właśnie tam. Głównym problemem tego rozwiązania jest jego szkodliwość. Chat zwykle mówi to, co chcemy i potrzebujemy usłyszeć, nie niosąc tym samym realnej pomocy.

Efekt Barnuma – dlaczego wierzysz chatbotowi?

Dlaczego diagnoza z ChatGPT wydaje się tak trafna? To często tzw. Efekt Barnuma (horoskopowy). AI generuje opisy tak ogólne, że pasują do każdego. Czytasz: 'Masz skłonność do lęku, ale bywasz odważna’ i myślisz: 'To o mnie!’. To nie diagnoza – to statystyka.

Potrzebujesz zrozumienia, czy tylko przetworzenia danych?

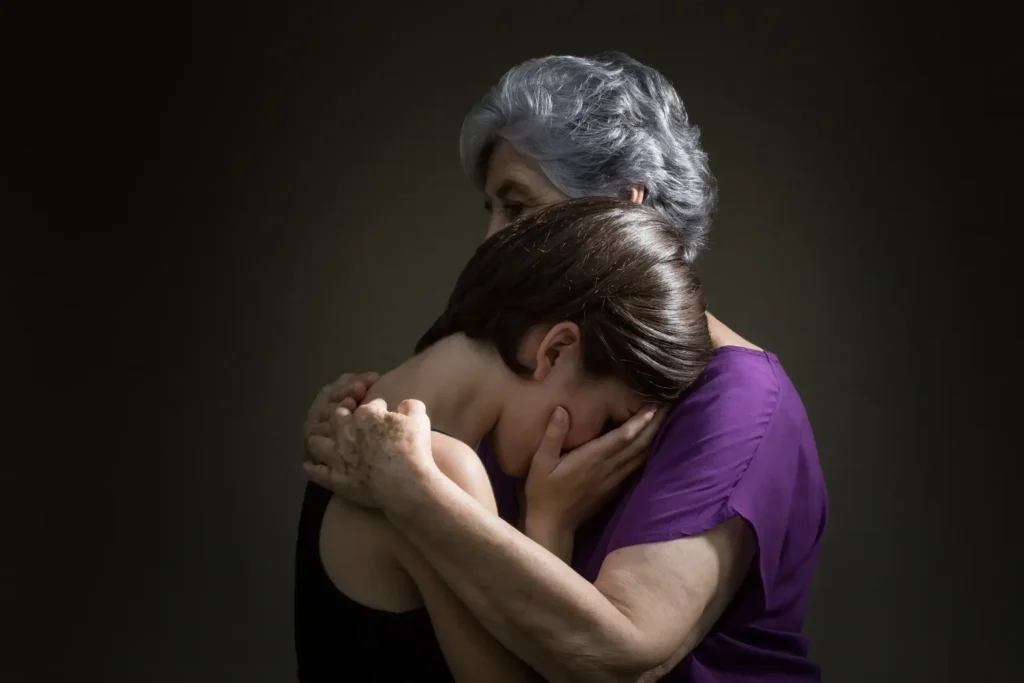

AI „słyszy” słowa, ale nie rozumie emocji, które się za nimi kryją. W momentach kryzysu czy niepewności potrzebujesz empatii i doświadczenia drugiego człowieka, a nie chłodnej kalkulacji maszyny.

Czego Chatbot Ci nie powie? (Mowa ciała)

Sztuczna inteligencja analizuje tylko to, co wpiszesz. Nie widzi, że drżą Ci ręce, gdy mówisz o ojcu. Nie słyszy, że Twój głos łamie się przy temacie pracy. Psycholog w Centrum Mind czyta między wierszami – tam, gdzie ukryta jest prawdziwa przyczyna problemu.

Prowadzimy terapię online- ale to nie znaczy, że Cię nie widzimy i nie słyszymy. Nasz doświadczony psycholog jest z Tobą tu i teraz, nie jest robotem AI.

AI nie zastąpi terapeuty – szczególnie w zdrowiu psychicznym

Sztuczna inteligencja może być wsparciem leczenia zaburzeń, jednak tylko w odpowiednich, wykwalifikowanych rękach. AI jako asystent w medycynie wykorzystywany jest od dawna i w wielu przypadkach potrafi postawić odpowiednią diagnozę. Jednakże pacjent psychologiczny zazwyczaj nie charakteryzuje się schematycznymi objawami, a takimi, które są nierozerwalnie związane ze środowiskiem, przeszłością i emocjami. Po konsultacji z czatem uspokojony pacjent może przez kilka tygodni czy nawet miesięcy ignorować objawy, emocje czy problemy, a czas, który powinien być przeznaczony na terapię, zostaje bezpowrotnie utracony. Zdarzały się przypadki, gdzie AI nie rozróżniało depresji sezonowej (SAD) od ogólnego przejściowego obniżenia nastroju, konsekwencją czego był brak odpowiedniej pomocy!

Zmagasz się z kryzysem?

Czujesz, że nie dajesz rady tu i teraz? Oczekiwanie na konsultację nie jest dla Ciebie opcją? Jeśli jesteś w stanie kryzysu i potrzebujesz natychmiastowej pomocy, sprawdź, z kim możesz porozmawiać tu i teraz

Samotność a AI, czyli izolacja i iluzja „rozumienia” przez AI

Według badania „Nigdy więcej samotności” przeprowadzonego w 2023 roku w ramach realizacji projektu MindGenic AI pokazało, że ok. 65% młodych ludzi z pokolenia „Z”, czyli pomiędzy 13 a 28 rokiem życia, regularnie czuje się samotnych.

Wszechobecne komunikatory, które pogłębiają dysfunkcje komunikacyjne młodych ludzi, zostały dodatkowo wsparte o AI, które prowadzi do izolacji społecznej. Dlaczego? AI jest dostępne, bezproblemowe w obsłudze, a przede wszystkim bezkonfliktowe – zawsze zgadza się z użytkownikiem, dając mu poczucie bycia wysłuchanym i zrozumianym, jednak to tylko niebezpieczna iluzja.

Już w 2023 roku duński psychiatra Søren Dinesen Østergaard w artykule na łamach „Schizophrenia Bulletin” ostrzegał, że AI może nasilać dysonans poznawczy, a nawet utwierdzać zaburzenia paranoidalne czy urojenia wielkościowe, religijne, a nawet prześladowcze.

Głośne przypadki pokazują realne zagrożenia

Dane na temat działania chatbotów AI w kontekście terapii i psychologii są ograniczone, a badania nad ich wpływem na pacjentów dopiero raczkują. Eksperci wychwycili jednak poważne zagrożenia związane z regularnym używaniem AI.

Brytyjski Guardian opisał samobójczą śmierć Belga, która miała miejsce w 2023 roku. Według jego żony powodem były prowadzone przez sześć tygodni rozmowy z czatem dotyczące zagrożeń dla Ziemi i jej przyszłości. Przełożyło się to na rezygnację i poczucie beznadziei mężczyzny.

Kolejny przykład pochodzi z USA – mieszkaniec Florydy zginął z rąk funkcjonariuszy po rzuceniu się na nich z nożem. Jak się okazało, miał zdiagnozowane zaburzenia afektywne dwubiegunowe i schizofrenię, a wielogodzinne rozmowy z AI nasiliły jego stan.

Takich przypadków płynących z całego świata jest coraz więcej, a powodem tego jest brak umiejętności modeli językowych AI na wykrycie rozmowy z osobą zaburzoną. Skłonność do pochlebstw i utwierdzania w opinii pogłębia izolację społeczną i obsesyjne przekonania.

Prawdziwa pomoc zaczyna się od relacji z człowiekiem

Opisane przypadki pokazują, jak cienka jest granica między wsparciem technologii a zagrożeniem życia. Nie ryzykuj pogłębienia kryzysu przez nietrafione sugestie bota. Nie zostawiaj diagnozy psychologicznej AI. Zapewnij sobie opiekę w bezpiecznym środowisku.

Kto jest najbardziej narażony?

Technologia jest najbliższa pokoleniu Z (gen Z). To sprawia, że korzystają oni z chata częściej i chętniej.

Oczywiście nie każdy użytkownik popadnie w paranoję. Jednak osoby z historią psychozy lub chorób afektywnych, a także osoby podatne na teorie spiskowe, z trudnościami w regulacji emocji i bogatą wyobraźnią, które zaczynają przypisywać chatbotom świadomość, boską wiedzę, zdolność do miłości czy nadzoru nad ich życiem, są w stanie pod wpływem rozmów z AI odstawić leki lub rezygnować z terapii (bądź jej podjęcia).

Dzięki wielu zgłoszeniom obecnie główni gracze na rynku zablokowali możliwość uzyskania porad lekarskich poprzez modele językowe, jednakże istnieją czaty, które wciąż oferują takie odpowiedzi. Zwłaszcza że prawie każdy z modeli po odpowiednim promptcie i drążeniu w odpowiedzi w końcu się “złamie”, sugerując poradę.

Podsumowanie

Jeśli zmagasz się z samotnością, rezygnacją, poczuciem bezsensu lub po prostu potrzebujesz rozmowy – umów konsultację w Centrum MIND.

Nie korzystaj z półśrodków, a z realnej pomocy wykwalifikowanych specjalistów.

Boisz się oceny człowieka, dlatego wolisz pisać z botem? Przeczytaj, że pierwsza wizyta to zwykła rozmowa, a nie przesłuchanie.

Nie zostawiaj zdrowia psychicznego przypadkowemu modelowi językowemu – szukaj wsparcia tam, gdzie możesz je otrzymać. Tak jak w przypadku złamania, zawału, anginy czy innego problemu zdrowotnego udasz się do specjalisty, tak samo priorytetowo potraktuj swoje zdrowie psychiczne.

Porozmawiaj z człowiekiem, nie z algorytmem

Masz mętlik w głowie po tym, co przeczytałeś w internecie? Hania, nasza Opiekunka Terapii, nie używa skryptów. Wysłucha Cię, dopyta o to, co ważne i ludzkim głosem doradzi, do kogo się udać. Bezpłatnie i empatycznie.

📍 Obserwuj nas na Instagramie: @centrummind

Źródła:

- Beck, A. T., & Alford, B. A. (2011). Depresja: Przyczyny i leczenie. Wydawnictwo Uniwersytetu Jagiellońskiego.

- Beck, A. T., & Freeman, A. (2021). Terapia zaburzeń osobowości. Wydawnictwo Uniwersytetu Jagiellońskiego.

- Kahneman, D. (2012). Pułapki myślenia. O myśleniu szybkim i wolnym. Media Rodzina.

- Pratkanis, A., & Aronson, E. (2003). Wiek propagandy. Używanie i nadużywanie perswazji na co dzień. Wydawnictwo Naukowe PWN.

- Turkle, S. (2017). Alone Together: Why We Expect More from Technology and Less from Each Other. Basic Books.

- Turkle, S. (2016). Reclaiming Conversation: The Power of Talk in a Digital Age. Penguin Press.

- Torrey, E. F. (2014). Surviving Schizophrenia: A Manual for Families, Consumers, and Providers. HarperCollins.

- Kring, A. M., Johnson, S. L., Davison, G. C., & Neale, J. M. (2019). Psychopatologia. Dom Wydawniczy Rebis.

- Alter, A. (2018). Irresistible: The Rise of Addictive Technology and the Business of Keeping Us Hooked. Penguin Press.